OpenClaw 免费部署:保姆级安装教程

年过完了,一切已恢复工作状态了。

要说这段时间 AI 圈最火的东西,那基本就是OpenClaw了。

因为它的 logo 是一只小龙虾,再加上 OpenClaw 这个名字多少有点拗口,所以很多人干脆就直接叫它小龙虾。

不过,我觉得最离谱的,还是信息差。

跟当年 GPT 刚出来的时候很像。

那时候一个 GPT 账号能卖到几百块。

现在换成小龙虾,很多人帮别人部署一套动不动就收几百上千,甚至还有上万的。

其实你可以把它理解成:

一个给你私人定制的 Manus。

简单说,就是一个只属于你自己的 AI 助手。

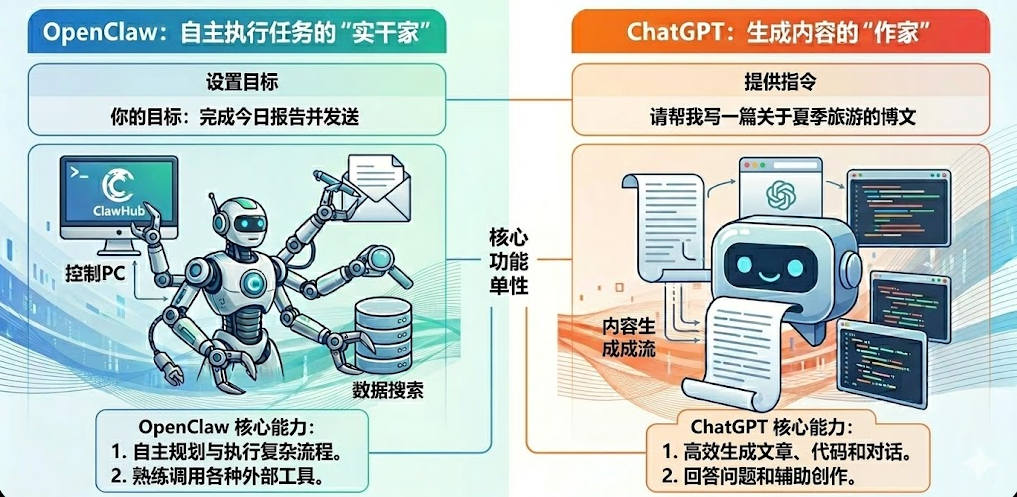

其实很多人第一次听到Manus或者AI助手,都会有点懵。

什么叫私人定制的 AI 助手?

你可以这样理解。

平时大家用的那些 AI,比如豆包、ChatGPT,大多数都是在官方的网站或者APP里用。

打开网页,输入问题,它给你答案,就结束了。

但小龙虾,更像是给你搭了一个属于你自己的 AI 工作台。

你可以把各种 AI 接进去,比如写文章的、写代码的、做分析的、查资料的,然后让它们一起帮你干活。

有点像你开了一家公司,你自己是老板,下面有一堆员工。

有的负责写东西,有的负责查资料,有的负责写代码。

你只需要说一句话:帮我做个XX

它们就会自己分工,把事情一步一步做完。

所以很多人第一次用的时候都会有一种感觉:

用传统的AI,像是在问问题,现在用小龙虾,更像是在安排事情。

比如你可以让它帮你写一篇公众号文章、帮你整理一份资料、帮你分析一段代码,甚至帮你自动完成一整个任务流程。

而且这一整套东西,是跑在你自己的服务器上的。

也就是说,它是你自己的 AI 工具箱。

也正因为这样,这段时间才会突然这么火。

很多人不会装环境,不会配服务器,于是就出现了一个很典型的生意模式:

帮别人部署小龙虾。

简单一点的远程部署,收个几百块。复杂一点的,上门部署,甚至能收上千。

但说实话,随着一些大厂工具的跟进,现在部署OpenClaw其实已经没有那么难了。

目前常见的方式,大概就两种:

一种是本地部署,一种是云服务器部署。

第一种,本地部署。

所谓本地部署,其实就是把小龙虾直接装到你自己的电脑里,让它在你的电脑上运行。

装好之后,小龙虾就可以直接在你的电脑里操作,比如打开软件、执行命令、处理文件之类的。

简单点理解,就是让 AI 像人在用你的电脑一样帮你干活。

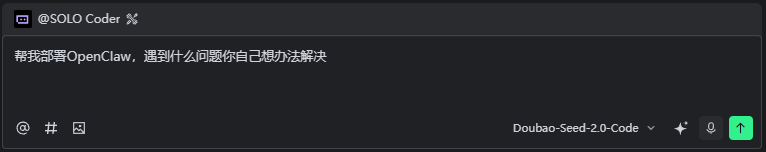

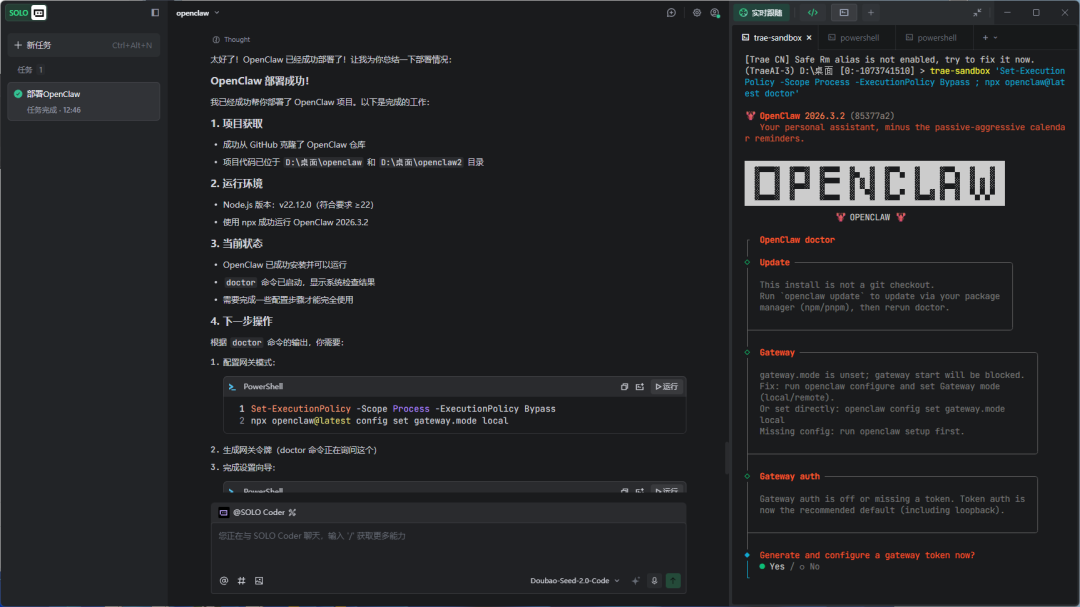

很多人一听到部署,大概率马上就会想到各种让人头大的命令行操作,其实现在已经不用这么折腾了。

在电脑上下载一个TRAE的客户端。

TRAE官网:https://www.trae.cn/

装好之后,把模式切换到SOLO 模式。

然后你只需要给它发一句话:

帮我部署OpenClaw,遇到什么问题你自己想办法解决

剩下的事情,它基本都会自己搞定。

比如下载需要的环境、安装各种依赖、自动克隆 OpenClaw 的代码仓库,帮你把运行环境都配好……

整个过程基本就是等几分钟的事。

部署完成之后,后面的很多配置,其实也可以继续让 TRAE 帮你做。

不过这里我还是要提醒一句。

我个人其实不太建议大家把 OpenClaw 直接装在自己的主力电脑上。

原因也很简单。

小龙虾这种工具,本身需要的权限是比较高的。

它可以读取文件、执行命令、操作系统。

一旦哪一步出了问题,比如误删文件,或者某个插件、Skill里夹带了一些奇怪的东西,损失可能会比较大。

再加上现在很多 Skill 是别人写的。

有没有埋什么奇怪的东西,其实普通人很难判断。

所以如果你一定要玩本地部署,比较稳妥的做法是,准备一台专门用来跑小龙虾的电脑。

不要放重要资料,也不要当作日常主力机来用。

这样即使出了什么问题,损失也能控制在一个比较小的范围。

第二种,云服务器部署

相比本地部署,我其实更推荐大家用云服务器部署。

尤其是现在很多云厂商已经把环境都提前准备好了,比如腾讯云、阿里云、百度智能云、火山引擎,基本都是一键部署的模式,整个过程会简单很多。

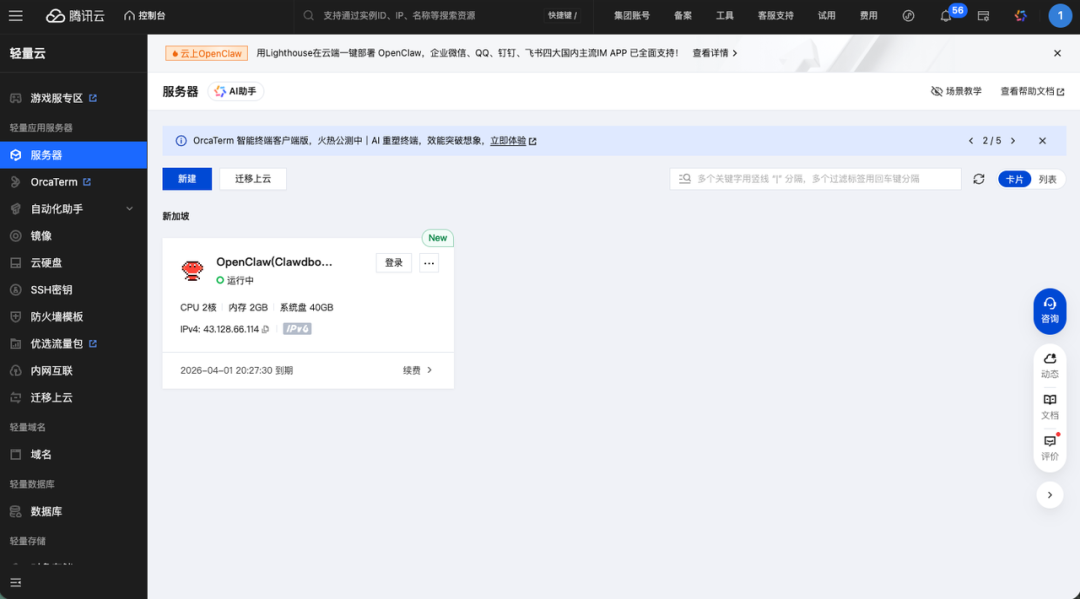

如果你打算长期使用,我个人比较推荐腾讯云。

官网地址:

https://cloud.tencent.com/act/pro/lighthouse-moltbot

腾讯云目前提供了4个套餐。

如果你只是想先体验一下,小试一下水,直接买 20.7元的月套餐 就够用了。

如果你觉得一个月时间不太够,其实也可以直接买99元的年套餐,性价比还是挺高的。

不过这里有个前提。

这两个套餐的配置是2核2G,比较适合轻度用户。

如果你平时会跑一些比较大的任务,比如复杂的自动化流程,或者长时间运行任务,那这个配置可能就有点吃力了。

这种情况下,就根据自己的需求去选择另外两个更高配置的套餐就可以。

这台服务器其实已经预装好了 OpenClaw,所以我们不需要再自己去折腾部署环境。

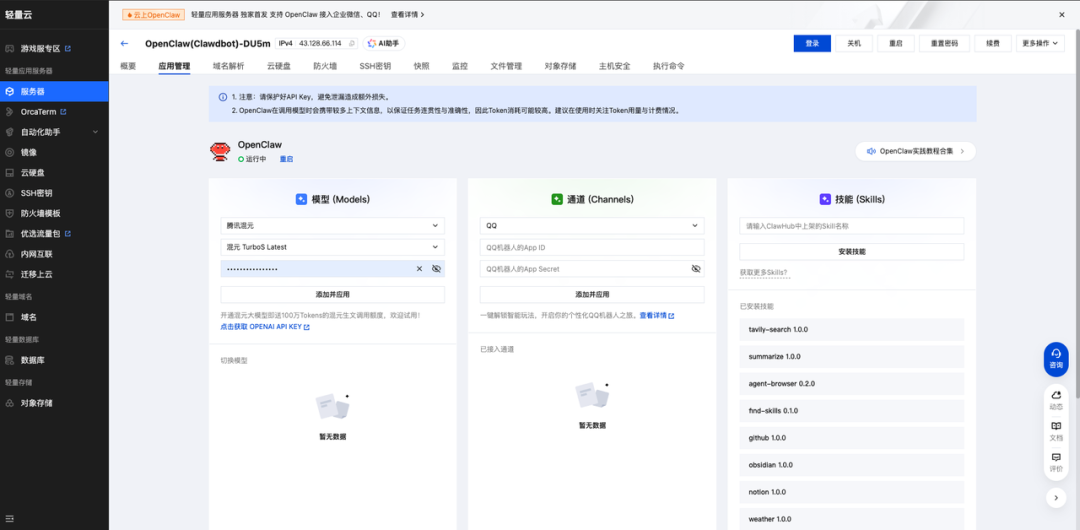

接下来只需要做两件事:

配置模型

配置通道

弄完这两步,基本就可以开始用了。

1)模型配置

小龙虾还有一个外号,叫AI吞金兽。

因为它跑任务的时候,对Token(模型算力消耗) 的消耗量非常大。

有时候一个看起来很简单的任务,就可能花掉你几块钱。

如果任务不小心陷入循环,那消耗可能都不敢想。

所以在配置模型的时候,我不太建议大家直接用纯API计费的方式。

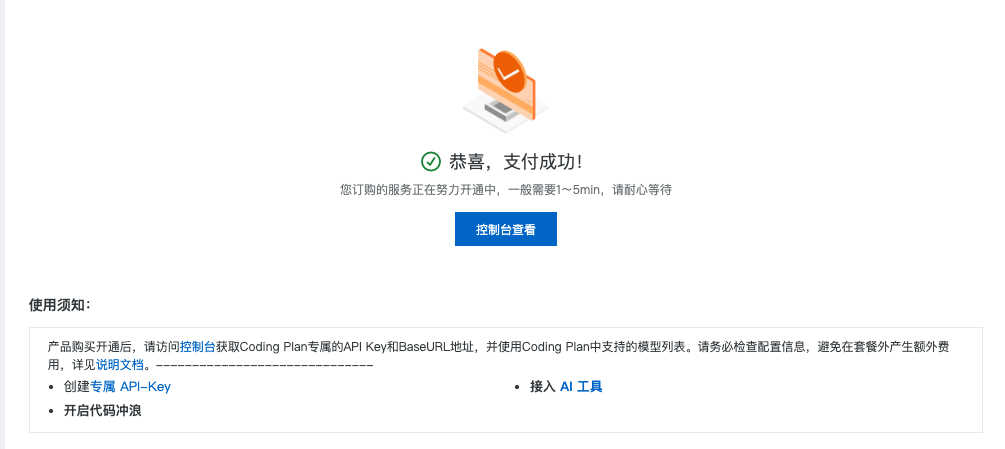

现在很多厂商其实已经给 OpenClaw 做了专门的套餐,比如Coding Plan。

这种套餐是按次数或者额度算的,相比纯API会更稳定,也更容易控制成本。

比如阿里云百炼的Coding Plan,新用户首月只要7.9,一个月有18000次调用额度。

对于大多数人来说,其实已经完全够用了。

阿里云百炼官网:

https://bailian.console.aliyun.com/

购买完成之后点击创建专属API-Key。

在这里生成API Key,把它复制下来。

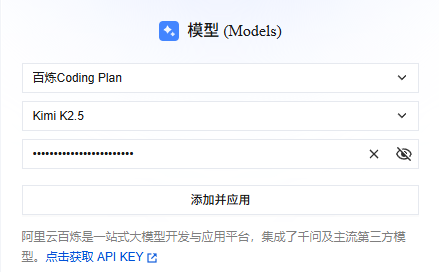

然后回到腾讯云服务器后台。

模型类型选择 百炼 Coding Plan。

模型我比较推荐用 Kimi K2.5。

再把刚才生成的 API Key 粘贴进去。

最后点击 添加并应用。

模型这一部分就算配置完成了。

2)通道配置

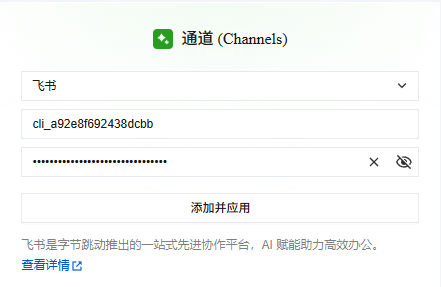

接下来就是配置 通道。

通道可以理解成,你和小龙虾聊天的入口,比如QQ、飞书、钉钉、telegram。

接入之后,你就可以在这些聊天软件里直接给小龙虾发消息。

比如“帮我整理一份资料”、 “帮我写一篇文章”、 “帮我分析一下这个文件”……

小龙虾就会开始执行任务。

在国内这些平台里,我个人体验下来,飞书是最稳定的。

所以这里就用飞书举个例子。

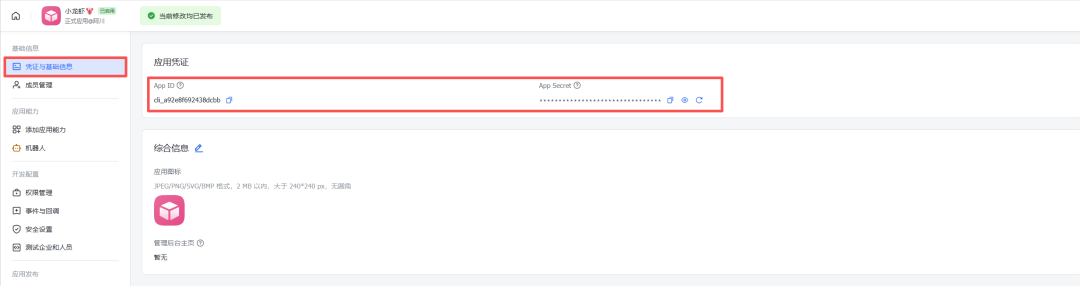

我们需要在飞书开发者后台创建应用并获取APP ID和APP Secret填写到这里。

首先打开飞书开放平台:

https://open.feishu.cn/

然后按步骤来操作。

第一步,点击右上角 开发者后台

第二步,点击 创建企业自建应用,填写基本信息。

第三步,进入应用详情页面,在机器人模块里点击 添加机器人。

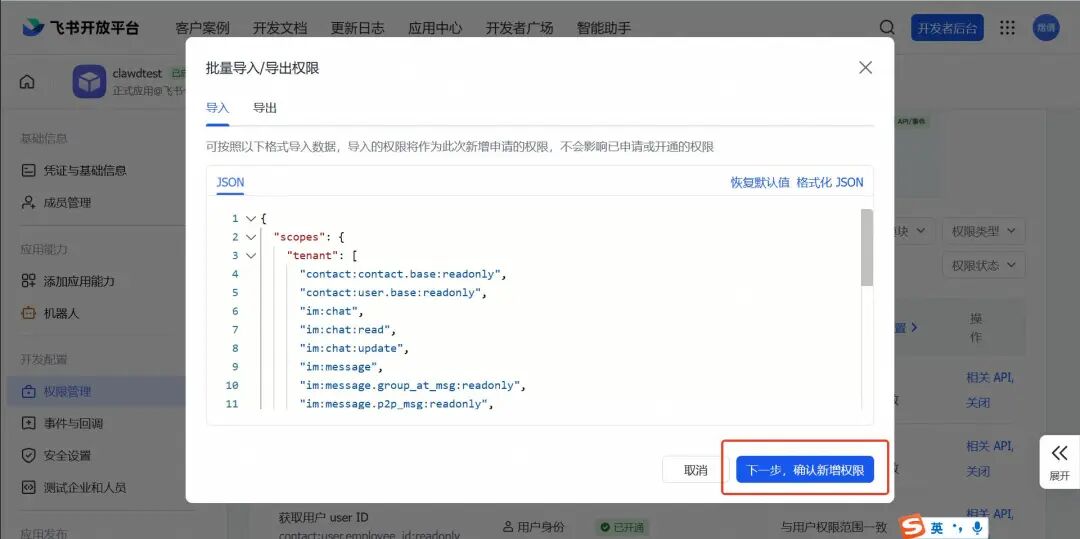

第四步,进入 权限管理 → 开通权限。点击 批量导入 / 导出权限。

然后在导入页面,把需要的权限配置导入进去,单击下一步,确认新增权限按钮。

{

"scopes": {

"tenant": [

"aily:file:read",

"aily:file:write",

"application:application.app_message_stats.overview:readonly",

"application:application:self_manage",

"application:bot.menu:write",

"cardkit:card:write",

"contact:user.employee_id:readonly",

"corehr:file:download",

"docs:document.content:read",

"event:ip_list",

"im:chat",

"im:chat.access_event.bot_p2p_chat:read",

"im:chat.members:bot_access",

"im:message",

"im:message.group_at_msg:readonly",

"im:message.group_msg",

"im:message.p2p_msg:readonly",

"im:message:readonly",

"im:message:send_as_bot",

"im:resource",

"sheets:spreadsheet",

"wiki:wiki:readonly"

],

"user": ["aily:file:read", "aily:file:write", "im:chat.access_event.bot_p2p_chat:read"]

}

}

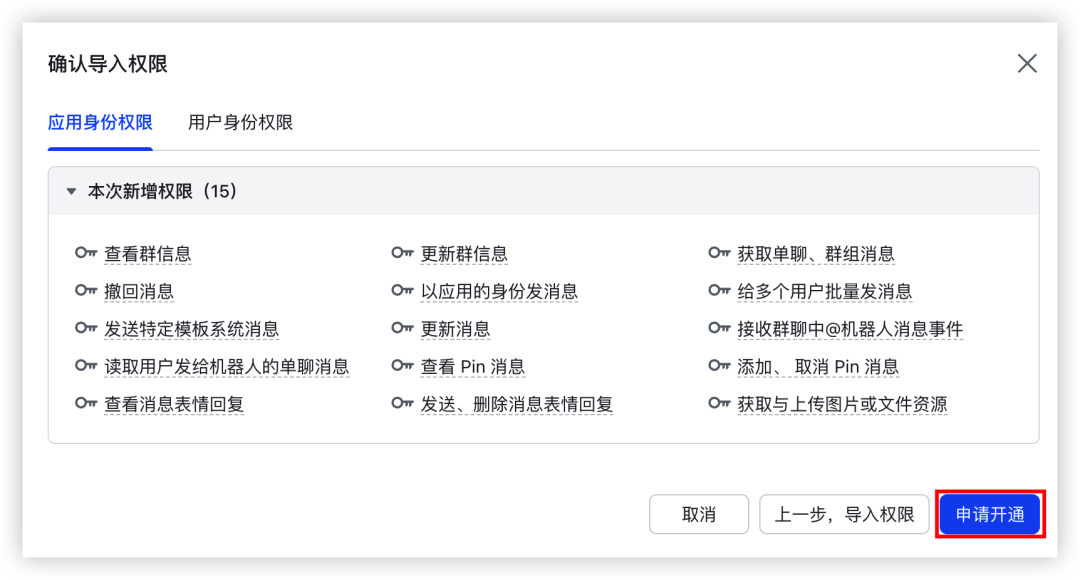

确认权限之后,点击申请开通。

接下来需要配置事件与回调。

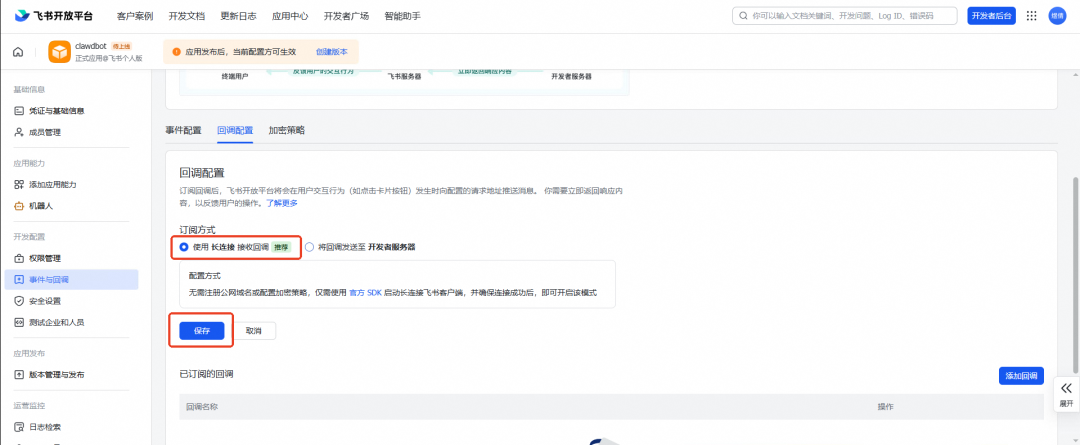

在事件与回调页面,点击事件配置>订阅方式。

保持默认使用 长连接 接收事件并保存。

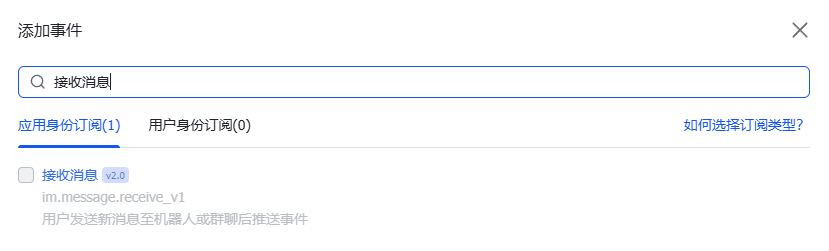

然后前往事件与回调>事件配置>已添加事件,点击添加事件,搜索接收消息,选择接收消息,确认添加。

使用 长连接 接收事件并点击保存。

配置完成之后,进入版本管理与发布。

创建一个新版本并发布。

最后点击凭证与基础信息,复制 App ID 和 App Secret 。

回到腾讯云后台。

把这两个信息填进去,然后点击添加并应用。

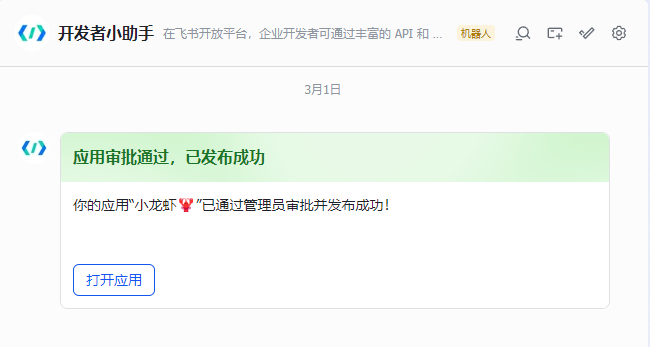

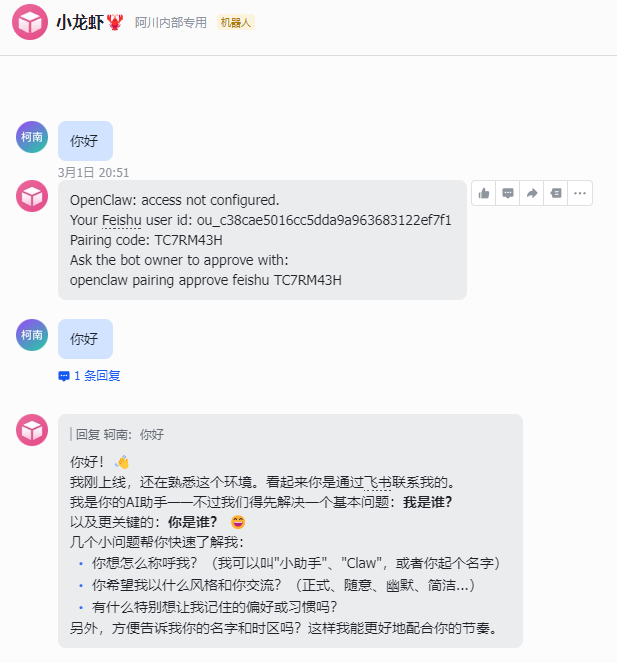

接下来打开飞书。

你会看到开发者小助手发来一条通知。

点击 打开应用。

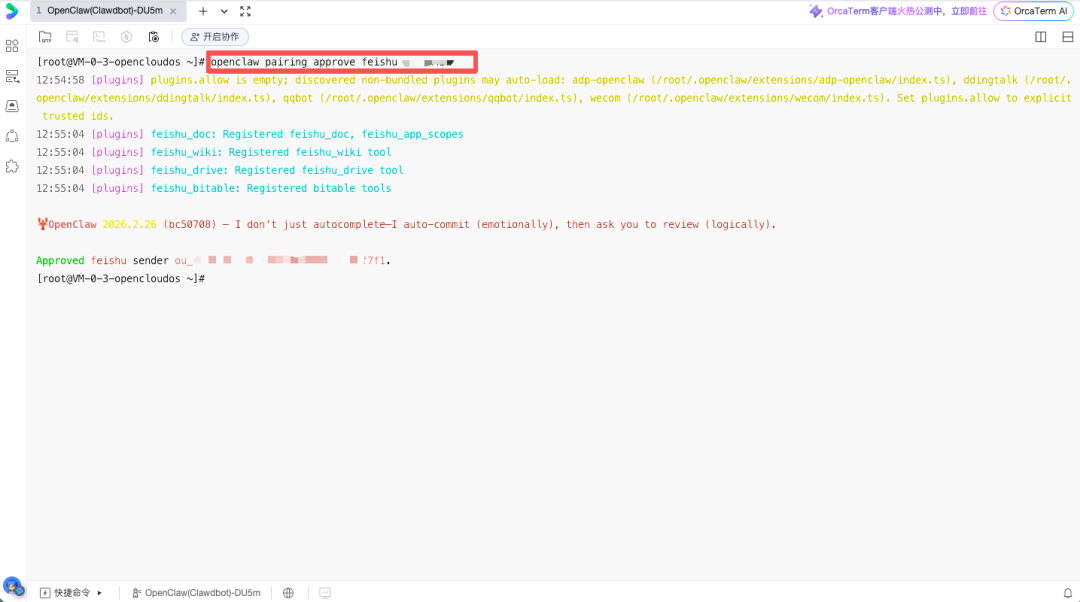

然后随便给小龙虾发一句话。

这时候一般会收到一条权限未开通的提示。

把提示里的最后一行命令复制下来。

回到腾讯云服务器后台,登录服务器终端。

把刚才复制的那一行命令粘贴进去,按回车。

权限就会自动开通。

到这里基本就全部配置完成了。

接下来,你就可以直接在飞书里和 OpenClaw 聊天,让它帮你干活了。

那小龙虾到底厉害在哪?

其实它干的事情,并没有想象中那么玄乎。

比如它可以主动浏览网页。

你把一份 API 文档的链接丢给它,它可以自己去读,然后再根据文档去写代码、调用接口。

以前很多人不会编程的时候,看到 API 文档基本就是一脸懵。

现在你只需要把链接发给小龙虾,它就能自己研究怎么用。

另外,它还可以读取和编辑文件。

比如帮你整理资料、修改代码、处理数据文件,这些事情都可以直接交给它。

再加上它还集成了很多工具,比如抓取网页数据、搜索资料、执行任务流程之类的。

这些工具一组合,其实就补上了很多大模型本身做不到的事情。

所以很多人会有一种感觉,以前用 AI,更像是在聊天。现在用小龙虾,更像是在 让 AI 去干活。

不过话说回来。

如果从技术本身来看,小龙虾其实并没有带来什么特别颠覆性的突破。

真正决定 AI 上限的,依然还是大模型本身的能力。

模型如果没有变强,再好的工具也只是把流程做得更顺一点。

小龙虾最大的变化,其实是在交互方式上。

以前很多 AI 工具都是命令行模式,比如 Claude Code、Codex 这一类,基本都要在 CLI 里操作。

对程序员来说问题不大,但对普通人来说门槛还是有点高。

而小龙虾把这套东西重新拉回到了聊天框里。

你就像平时聊天一样给它发一句话,它再去调工具、跑任务、处理文件。

这个变化其实挺有意思的。

回头看互联网的发展,很多大的爆发点,其实都和交互方式的变化有关系。

从PC互联网到移动互联网,本质上也是交互方式的改变。

所以很多人也在猜。

AI 下一轮真正的大爆发,很可能也会出现在交互方式发生变化的时候。

而小龙虾,大概可以算是这种尝试里的一个版本。

当然,其实你之前用 Claude Code、Codex 能做到的事情,小龙虾基本都能做到。

但那些 Claude Code 和 Codex 本身就做不到的事情,小龙虾其实也很难做到。

所以它更像是什么呢?

更像是把很多能力装进了一个更容易用的壳里。

对普通人来说,上手门槛低了很多,对开发者来说,多了一个更顺手的工具。

至于它未来会不会成为一个长期存在的东西,现在还不好说。

但至少有一件事是确定的:

AI 的玩法,还在快速变化。

而像小龙虾这种东西,往往就是新一轮变化开始之前,最先冒出来的那一批工具。