想做AI漫剧短剧?这个新工具可能是你的最佳搭

这是第 946 篇干货分享。

——

之前给大家深度测评完LibTV的各种硬核玩法,很多伙伴上手操作之后,反馈都还不错。

但也有一些不一样的声音。比如:视频模型虽然很丰富,但还是稍显普通,总觉得差点意思......

今天再次使用LibTV的时候,突然发现,LibTV StarVideo2.0 模型迎来正式上线了!

让大家期待已久的视频生成模型,它还真来了。

先给大家展示几个用LibTV StarVideo 2.0 模型一键生成的视频片段,大家感受一下,就知道效果怎么样了。

美食探店Vlog:

电商广告:

AI漫剧打斗:

是不是还不错?全程我们只需要输入简单的创意描述,即可生成包含分镜、转场、音频、节奏控制等在内的完整视频内容。

LibTV一站式内容创作的最后一块短板,就这么丝滑的补齐了。

下面通过实际的操作,以AI剧情类短剧为例,手把手教大家如何用StarVideo 2.0 模型,快速出片。

官网:https://www.liblib.tv/

所有的操作都在LibTV中进行,具体步骤如下:

-打开LibTV

-生成剧本

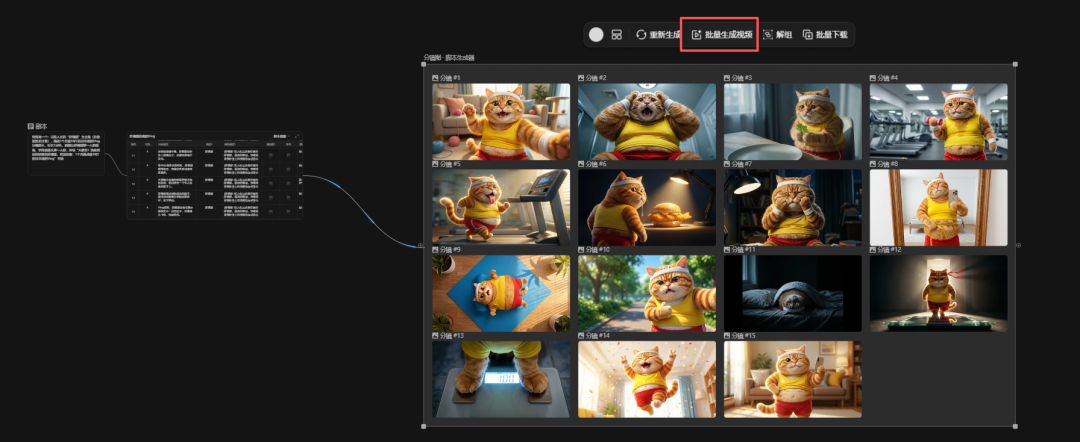

-剧本批量生成图片

-批量生成视频

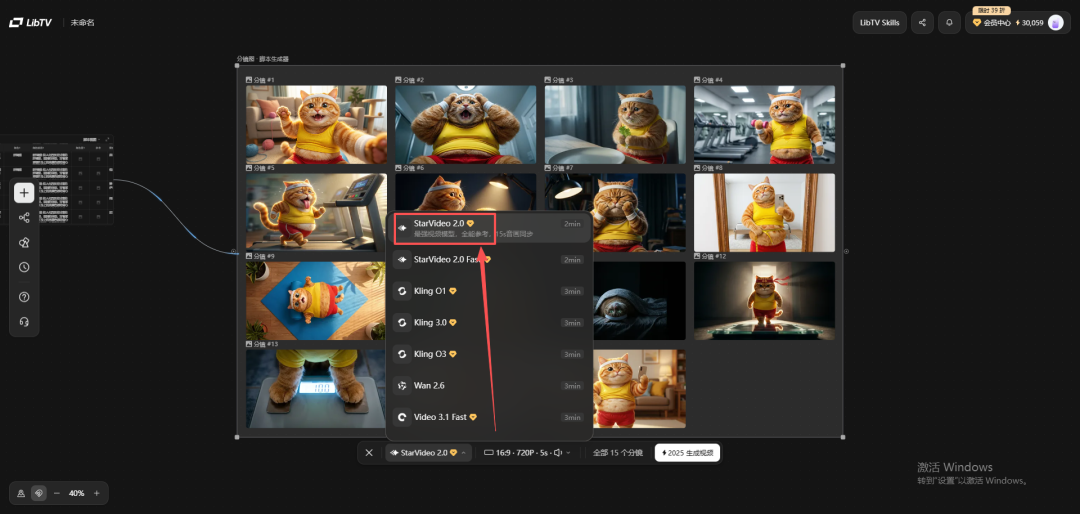

-选择模型

-设置比例&时长

-发送生成

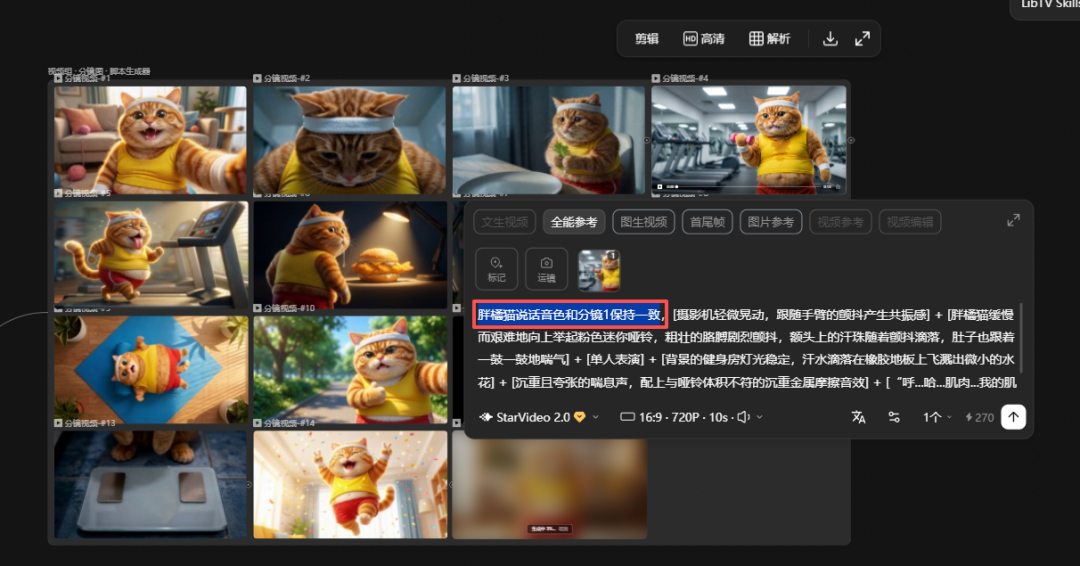

批量生成的每一个分镜,都支持自定义修改,遇到不满意的镜头,选择重新生成即可。

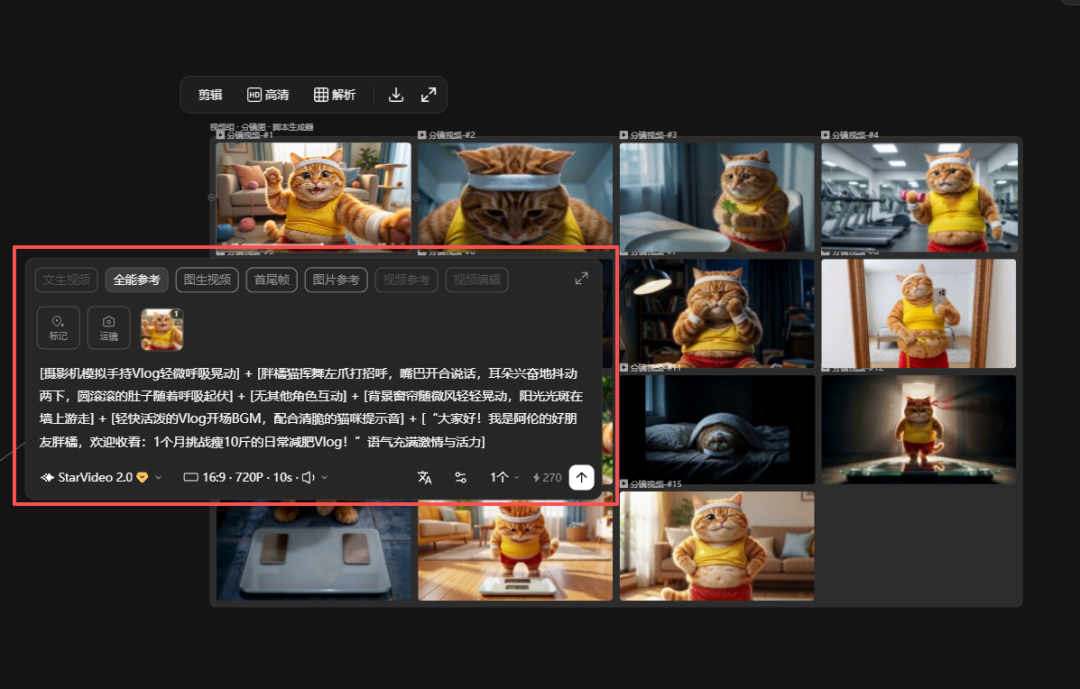

大家在批量生成时,可能会遇到一个小问题,那就是音色不统一。

反复测试了几个不同的案例,摸索出了一个小技巧,可以很好地解决这个问题。

那就是在每个分镜前统一加一句:音色与XXX(镜头1或者某分镜中的人物等)保持一致。

部分分镜效果如下:

分镜1

分镜7

分镜9

分镜18

......

完整成片效果如下:

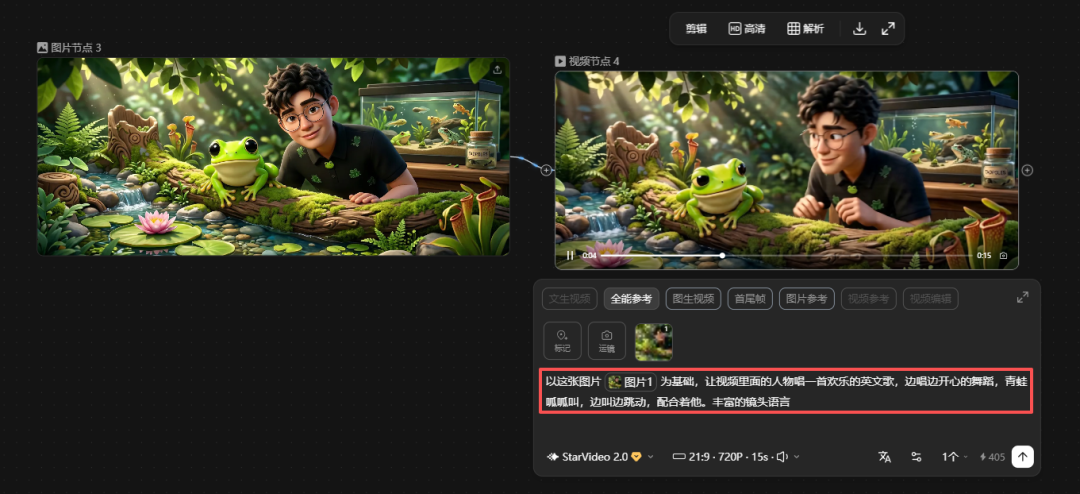

当然,如果你不需要剧本,不想要长剧情,还可以直接上传你需要生成视频的图片或者文字。

比如:以图片为基础,让视频里面的人物唱一首欢乐的英文歌,边唱边开心的舞蹈,青蛙呱呱叫,边叫边跳动,配合着他。

等待几秒钟,你就会得到这样的一个视频:

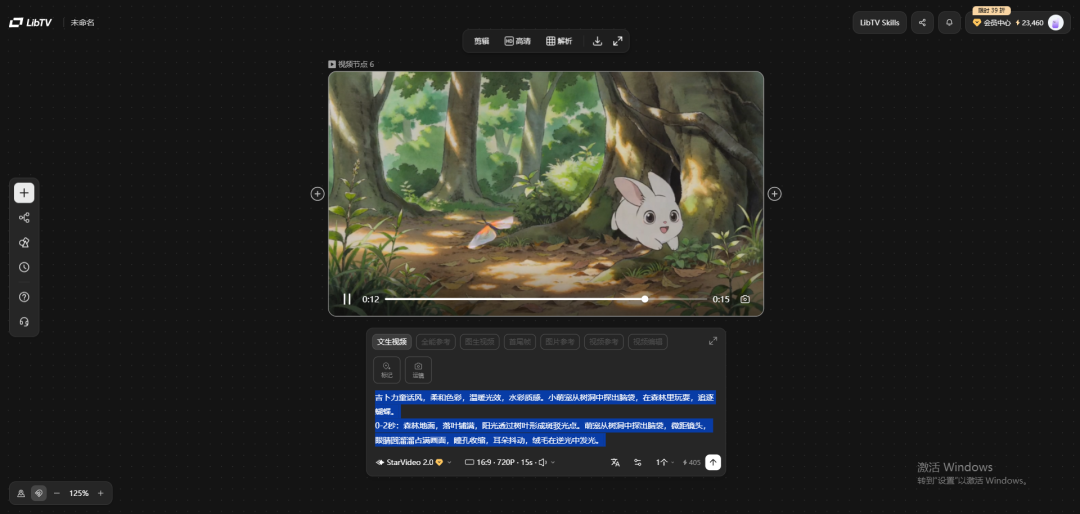

你也可以丢给它精确到每一秒的分镜/音频/运镜等提示词,让它去自由发挥。

吉卜力童话风,柔和色彩,温暖光效,水彩质感。小萌宠从树洞中探出脑袋,在森林里玩耍,追逐蝴蝶。 0-2秒:森林地面,落叶铺满,阳光透过树叶形成斑驳光点。萌宠从树洞中探出脑袋,微距镜头,眼睛圆溜溜占满画面,瞳孔收缩,耳朵抖动,绒毛在逆光中发光。 2-4秒:它小心翼翼地爬出树洞,低机位跟拍,踩到一片落叶,落叶发出咔嚓声,它吓得跳起,四肢腾空,毛发炸开。 4-6秒:落地不稳,滚成一团毛球,顺着小坡滚下,镜头跟随滚动,速度逐渐加快,草叶从镜头前划过。 6-8秒:撞到树根停下,它晕乎乎爬起来,头上转着星星,甩甩脑袋。特写,眼神迷糊,瞳孔还未聚焦。 8-10秒:它发现一只蝴蝶,耳朵竖起,眼睛发亮。镜头从背后越过肩膀,蝴蝶在阳光下翅膀半透明。 10-15秒:它兴奋地追着蝴蝶跑出画面,镜头留在原地,只有落叶缓缓飘下,阳光继续斑驳。最后画面渐暗,仿佛时间静止。

这样你将会得到一个这样的视频:

无限画布+顶尖模型+全能工作流,搞定了从脚本到分镜、图片、视频、配音、剪辑.....与创作相关的几乎所有环节。

这样的平台,尤其适合AI短剧/漫剧等相关内容的创作,至于其它的视频类型,完全是降维打击。

不过可惜的是,目前StarVideo2.0模型只面对企业团队申请开放。可以期待一下,相信要不了多久,人人都能用得上。

另外在LibTV官网还发现,目前还有“百万AI影像狂飙季”官方大赛,奖金直接拉满了,感兴趣的伙伴可以去官网报名参加~